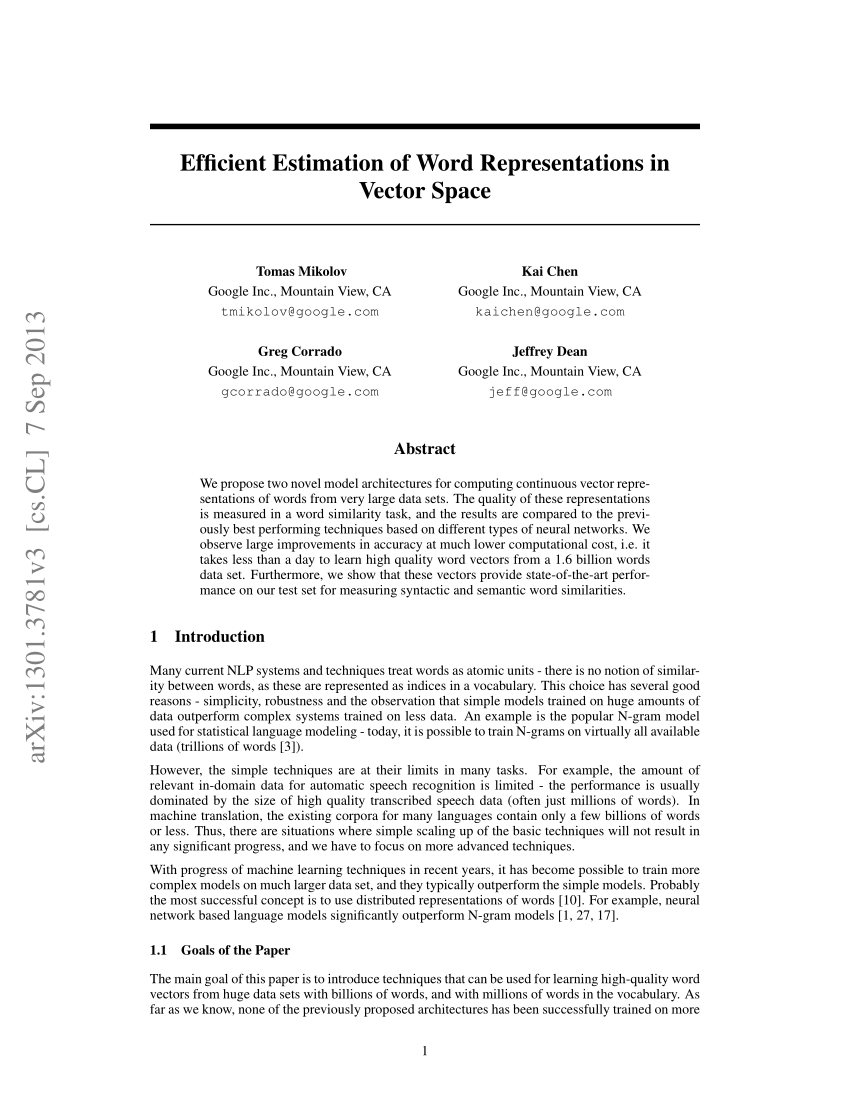

Efficient Estimation Of Word Representations In Vector Space

Stell dir vor, Wörter wären wie kleine, lebendige Wesen. Jedes hat seine eigene Persönlichkeit, seine eigenen Freunde und Feinde, und seinen eigenen Lieblingsplatz im Universum der Sprache. Aber wie finden wir heraus, wer mit wem abhängt? Wie ordnen wir dieses bunte Haufen von Wörtern so an, dass wir ihre Beziehungen verstehen können?

Nun, eine super coole Methode ist, jedes Wort in einen winzigen Vektor zu verwandeln! Stell dir einen Vektor als einen Pfeil vor, der in eine bestimmte Richtung zeigt. Und jedes Wort bekommt seinen eigenen, einzigartigen Pfeil im gigantischen, mehrdimensionalen Raum der Wörter. Klingt verrückt? Ist es auch, aber auf eine gute Art!

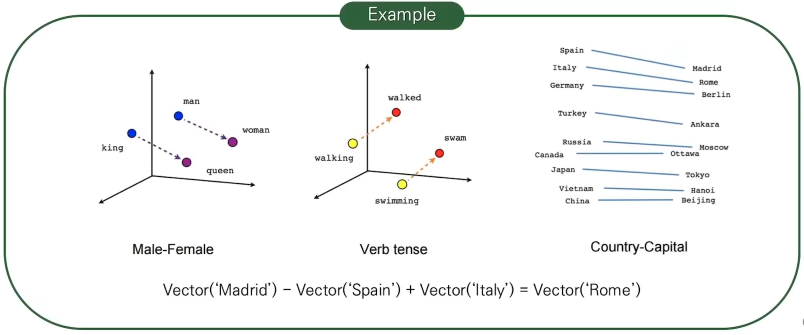

Diese Pfeile, die wir Word Representations nennen, verraten uns, wie ähnlich sich Wörter sind. Wenn zwei Pfeile in etwa die gleiche Richtung zeigen, bedeutet das, dass die dazugehörigen Wörter wahrscheinlich oft zusammen auftreten oder eine ähnliche Bedeutung haben. Zum Beispiel würden die Pfeile für "König" und "Königin" wahrscheinlich recht nah beieinander liegen, während "König" und "Fahrrad" sich eher fremd gegenüberstehen würden. Das ist wie im echten Leben: König und Königin hängen eher zusammen als König und Fahrrad, oder?

Training der Wort-Pfeile: Ein Vokabel-Fitnessstudio für Computer

Aber wie kriegen wir diese Pfeile überhaupt? Hier kommt das "Training" ins Spiel. Wir füttern den Computer mit riesigen Mengen an Text, quasi das tägliche Workout im Vokabel-Fitnessstudio. Der Computer liest und liest und liest, und während er das tut, lernt er, welche Wörter oft zusammen auftreten. Er beobachtet, wie Wörter sich in Sätzen verhalten, wer mit wem flirtet und wer sich eher aus dem Weg geht.

Nehmen wir an, der Computer liest den Satz: "Der König liebte es, mit seiner Königin im Garten spazieren zu gehen." Der Computer merkt sich: "Aha, König und Königin tauchen oft zusammen auf! Die scheinen sich zu mögen!" Und so justiert er die Pfeile für "König" und "Königin" ein bisschen näher zueinander. Wenn er dann noch liest: "Der König erließ ein neues Gesetz," dann merkt er sich, dass König auch was mit "Gesetz" zu tun hat und justiert den Pfeil entsprechend.

Das Ganze ist wie ein gigantisches Puzzle, bei dem der Computer versucht, die Beziehungen zwischen den Wörtern zu verstehen und die Pfeile so auszurichten, dass sie ein sinnvolles Bild ergeben. Je mehr Text der Computer liest, desto besser werden die Pfeile und desto genauer wird das Bild der Beziehungen zwischen den Wörtern. Nach ein paar Tagen des Trainings hat der Computer eine supercoole Landkarte des Wortuniversums erstellt!

Die Magie der Mathematik

Das Geniale daran ist, dass wir mit diesen Vektoren auch mathematische Operationen durchführen können! Stell dir vor, du nimmst den Vektor für "König", subtrahierst den Vektor für "Mann" und addierst den Vektor für "Frau". Was kommt dabei raus? Bingo: Der Vektor für "Königin"! Das ist, als würden wir mit Legosteinen der Sprache bauen und neue Wörter zusammensetzen!

Das ist natürlich eine Vereinfachung, aber es zeigt das unglaubliche Potenzial dieser Technik. Wir können damit Analogien erkennen, Beziehungen aufdecken und sogar neue Ideen generieren. Es ist, als hätten wir einen Zauberstab für die Sprache entdeckt!

Und das Beste daran? Es geht auch noch effizient! Die Technik ist nicht nur supermächtig, sondern auch noch ziemlich schnell. Das ist, als hätte man ein Rennauto, das gleichzeitig ein Raumschiff ist!

Anwendungen: Vom Chatbot zum Dichter-Roboter

Was können wir nun mit diesen Wort-Pfeilen anstellen? Eine ganze Menge! Sie werden in allen möglichen Bereichen eingesetzt:

- Chatbots: Um zu verstehen, was du von ihnen willst.

- Übersetzungsprogramme: Um Texte von einer Sprache in eine andere zu übersetzen.

- Suchmaschinen: Um bessere Suchergebnisse zu liefern.

- Sentimentanalyse: Um herauszufinden, ob ein Text positiv oder negativ ist.

- Und sogar, um Gedichte zu schreiben! (Okay, vielleicht noch nicht so gute Gedichte, aber immerhin!)

Die Möglichkeiten sind endlos! Die Word Representations sind wie ein universelles Werkzeug, das uns hilft, die Sprache besser zu verstehen und sie auf neue und aufregende Weise zu nutzen.

Also, das nächste Mal, wenn du einen Text liest, denk an die kleinen Vektoren, die im Hintergrund arbeiten und die Beziehungen zwischen den Wörtern aufdecken. Es ist eine faszinierende Welt voller Möglichkeiten, und wir haben gerade erst angefangen, sie zu erkunden! Die Worte sind wie lebendige Wesen, und wir haben gelernt, ihre Sprache zu verstehen. Die Reise geht weiter...

![Efficient Estimation Of Word Representations In Vector Space [paper review] Efficient Estimation of Word Representations in Vector Space](https://velog.velcdn.com/images/jeongminii/post/3a9effe6-1bd3-4674-8a46-59c7a6d7f50e/image.png)

![Efficient Estimation Of Word Representations In Vector Space [Paper Review] Efficient Estimation of Word Representations in Vector](https://blog.kakaocdn.net/dn/Qbypo/btsFDVruNP6/vVUrW2JeeUBakW7kTfIVck/img.png)