Gauss Markov Theorem Assumptions

Lineare Regression: Mehr als nur eine Linie!

Stell dir vor, du versuchst, eine Linie durch eine Punktewolke zu ziehen. Keine Hexerei, oder? Aber was, wenn diese Linie die beste Linie sein soll? Hier kommt die lineare Regression ins Spiel! Sie ist wie ein Detektiv, der die verborgenen Beziehungen zwischen Variablen aufdeckt.

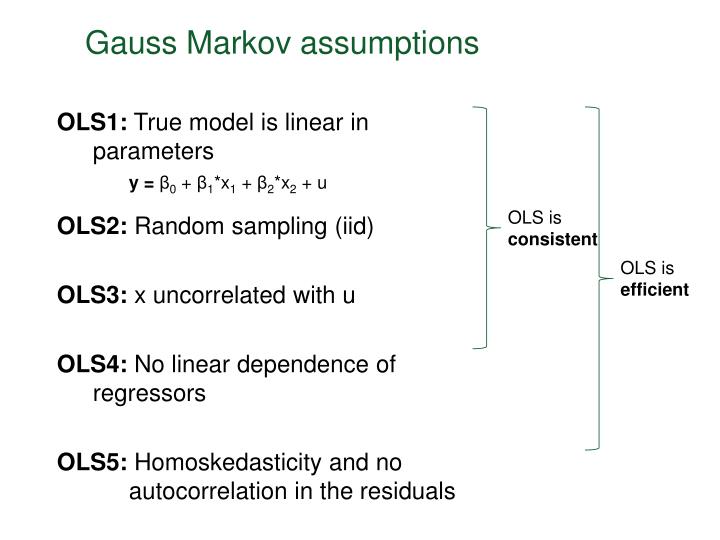

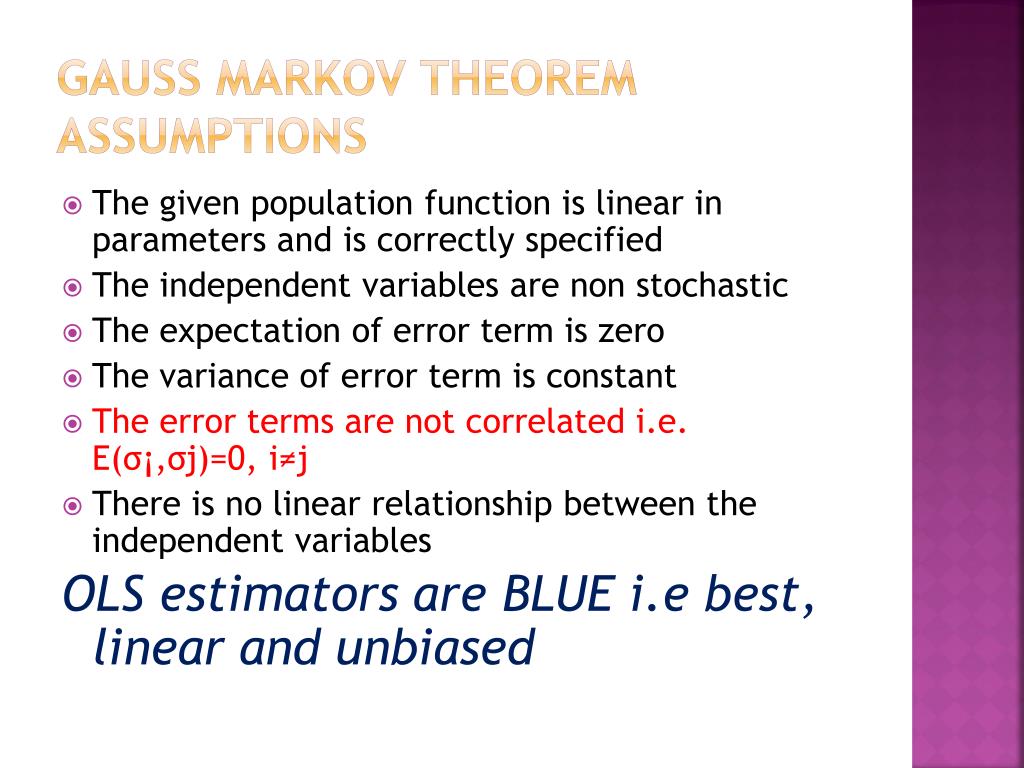

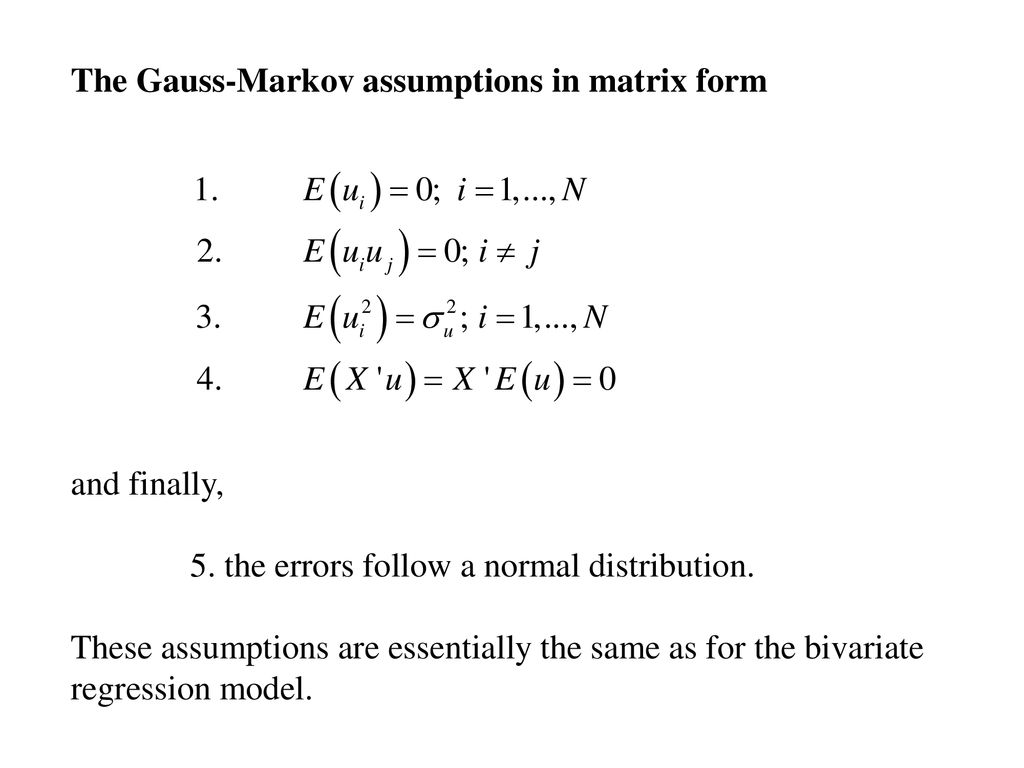

Aber warte! Bevor wir Sherlock Holmes spielen, müssen wir uns an ein paar Regeln halten. Diese Regeln sind wie die Spielregeln eines Brettspiels. Sie heißen die Gauss-Markov-Annahmen. Klingt kompliziert? Keine Sorge, wir brechen sie runter!

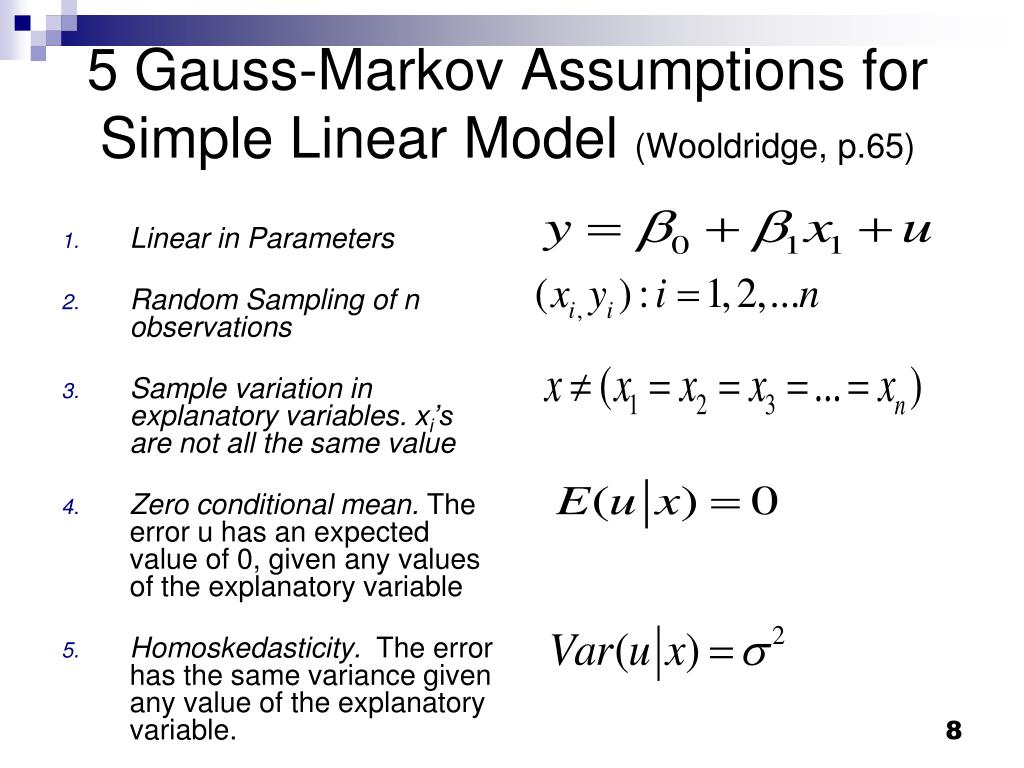

Annahme 1: Linearität – Kein Zickzack!

Stell dir vor, du willst den Zusammenhang zwischen der Anzahl der Eis, die du isst, und deiner Glückseligkeit herausfinden. Die Annahme der Linearität besagt: Dieser Zusammenhang muss linear sein. Das heißt, er lässt sich durch eine gerade Linie beschreiben. Keine wilden Kurven oder Zickzacklinien! Wenn der Zusammenhang krumm ist, musst du andere Tricks anwenden. Denk an Transformationen der Daten oder ganz andere Modelle!

Annahme 2: Exogenität – Die Unabhängigen müssen unabhängig sein!

Okay, das klingt jetzt wirklich wissenschaftlich. Aber im Grunde bedeutet es: Die Variablen, mit denen du etwas erklären willst (die unabhängigen Variablen), dürfen nicht von dem beeinflusst werden, was du erklären willst (die abhängige Variable). Stell dir vor, du willst den Zusammenhang zwischen der Menge an Dünger und dem Ertrag deiner Tomatenpflanzen untersuchen. Die Menge an Dünger darf nicht vom Ertrag der Tomaten beeinflusst werden. Du kannst ja nicht anhand der geernteten Tomaten entscheiden, wie viel Dünger du gibst, oder?

Annahme 3: Keine perfekte Multikollinearität – Nicht alle reden gleichzeitig!

Diese Annahme betrifft nur Modelle mit mehreren erklärenden Variablen. Sie besagt, dass deine erklärenden Variablen nicht perfekt voneinander abhängen dürfen. Stell dir vor, du willst erklären, wie gut ein Kuchen schmeckt. Du nimmst als Variablen die Menge an Zucker und die Menge an Süßstoff. Wenn du immer genau die gleiche Menge an Zucker durch Süßstoff ersetzt, dann sind deine Variablen perfekt korreliert. Das verwirrt das Modell, denn es kann nicht mehr unterscheiden, was welchen Einfluss hat. Es ist, als würden alle gleichzeitig reden – man versteht nichts!

Annahme 4: Homoskedastizität – Gleiche Chancen für alle!

Dieser Begriff ist ein echter Zungenbrecher! Aber keine Angst, die Idee dahinter ist einfach. Homoskedastizität bedeutet, dass die Streuung der Fehler (also der Unterschied zwischen dem, was dein Modell vorhersagt, und dem, was wirklich passiert) konstant sein muss. Stell dir vor, du schätzt die Körpergröße von Leuten anhand ihres Alters. Wenn die Streuung der Fehler bei jüngeren Leuten geringer ist als bei älteren (weil ältere Leute unterschiedlicher groß sind), dann hast du keine Homoskedastizität. Das ist wie beim Dartspielen: Wenn deine Würfe immer ungenauer werden, je weiter du von der Scheibe weg bist, dann ist die Streuung nicht konstant!

Annahme 5: Keine Autokorrelation – Keine Abhängigkeiten in den Fehlern!

Autokorrelation bedeutet, dass die Fehler in deinem Modell voneinander abhängen. Stell dir vor, du schätzt die Verkaufszahlen eines Eiswagens über die Zeit. Wenn ein Fehler in einer Woche dazu führt, dass der Fehler in der nächsten Woche ähnlich ist (zum Beispiel, weil das Wetter ähnlich ist), dann hast du Autokorrelation. Das ist wie beim Dominoeffekt: Ein Fehler zieht andere Fehler nach sich!

Was passiert, wenn die Annahmen verletzt werden?

Keine Panik! Das ist nicht das Ende der Welt. Aber es bedeutet, dass deine Ergebnisse möglicherweise nicht mehr so zuverlässig sind. Die Schätzungen deiner Parameter (also der Zahlen, die die Linie beschreiben) könnten verzerrt sein. Die Standardfehler (die angeben, wie genau deine Schätzungen sind) könnten falsch sein. Und das bedeutet, dass du falsche Schlüsse ziehen könntest.

Zum Glück gibt es Möglichkeiten, mit verletzten Annahmen umzugehen. Du kannst zum Beispiel deine Daten transformieren, andere Modelle verwenden oder robustere Methoden anwenden. Denk daran: Die Gauss-Markov-Annahmen sind keine unüberwindbaren Mauern, sondern Wegweiser, die dir helfen, den richtigen Weg zu finden!

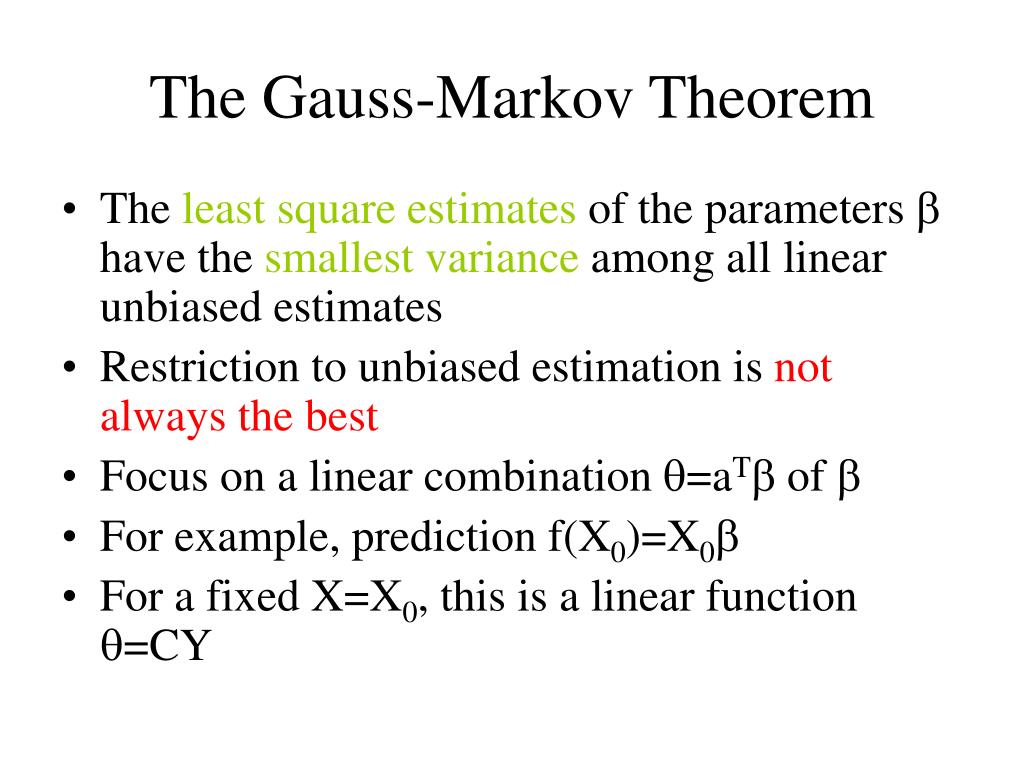

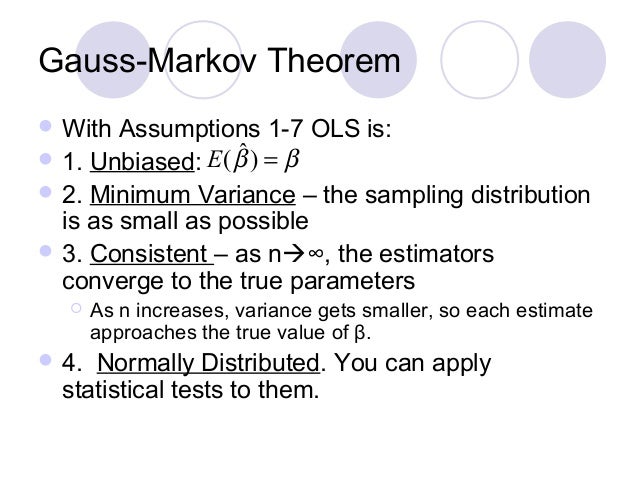

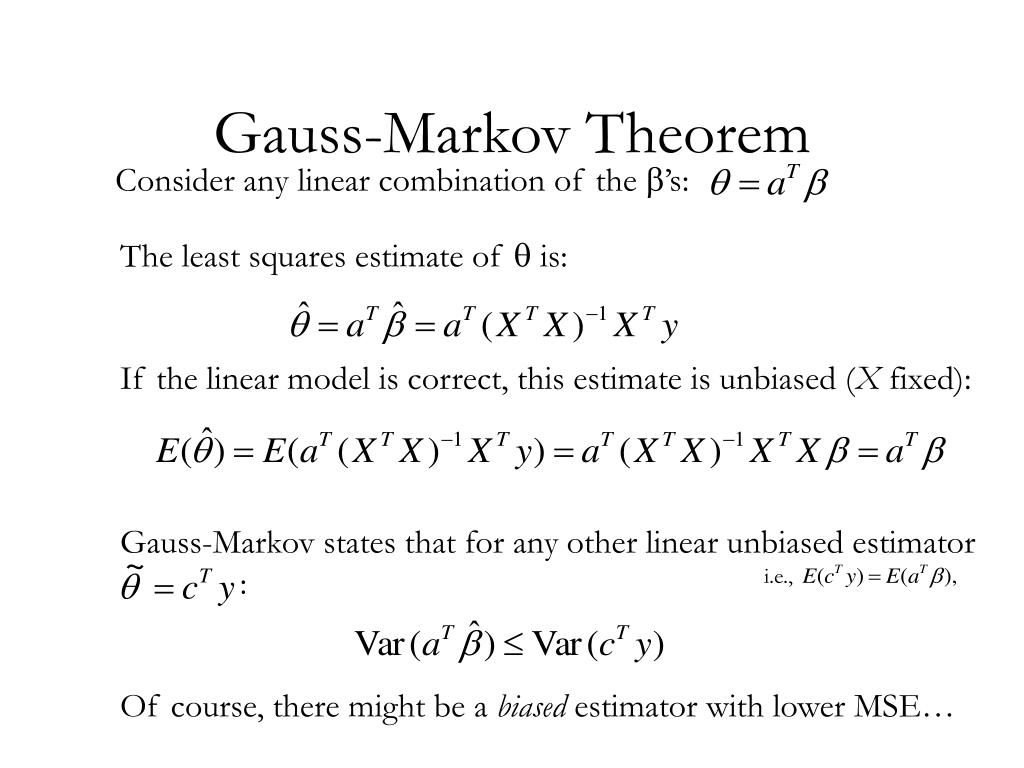

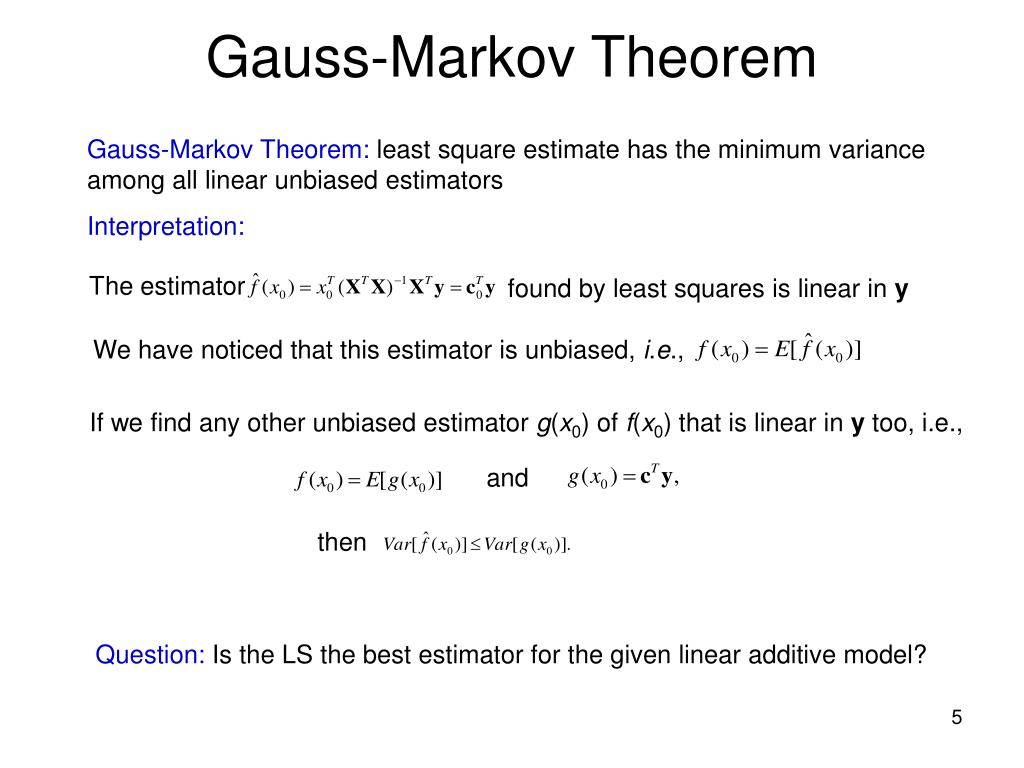

Warum sind die Gauss-Markov-Annahmen so wichtig?

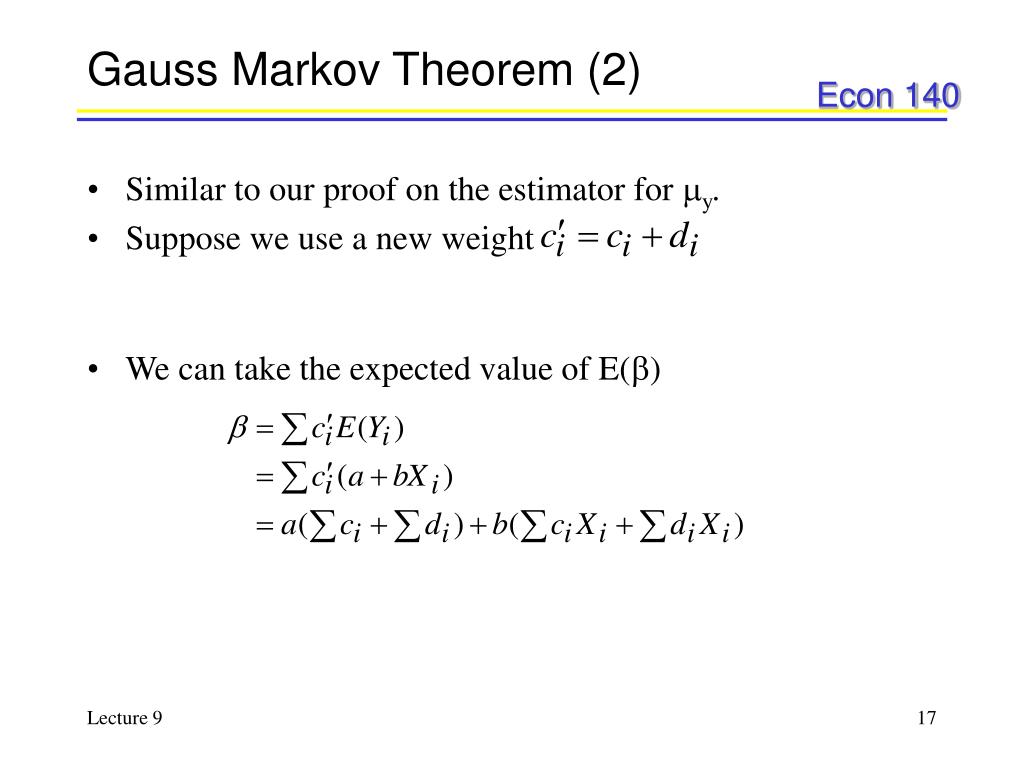

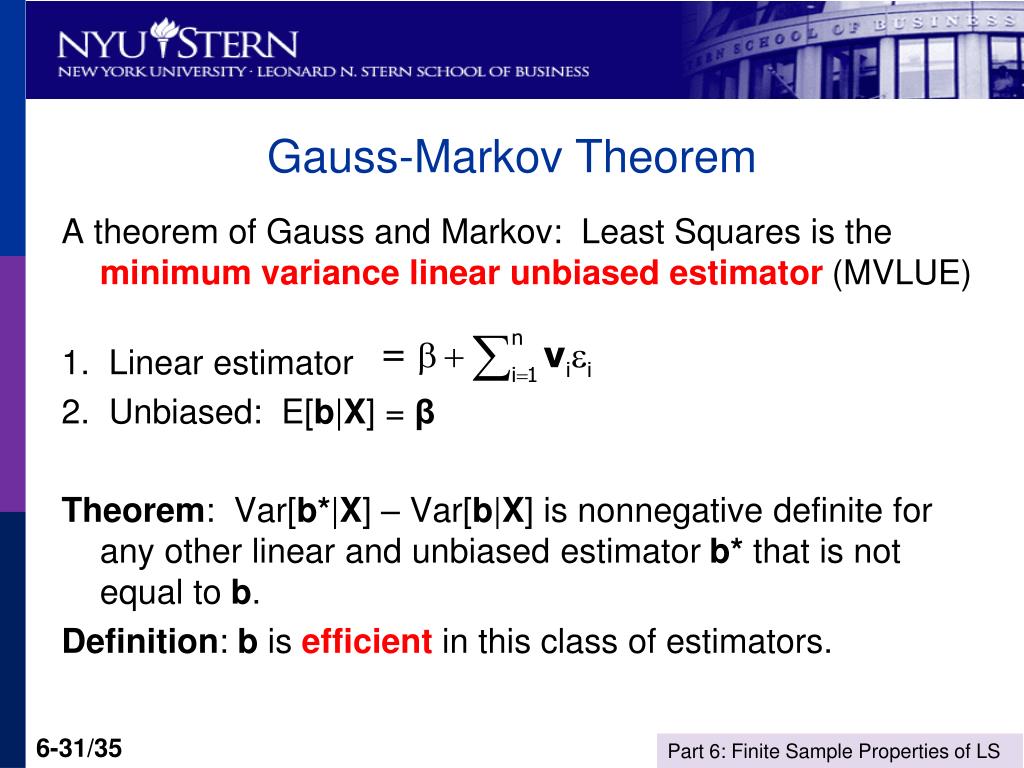

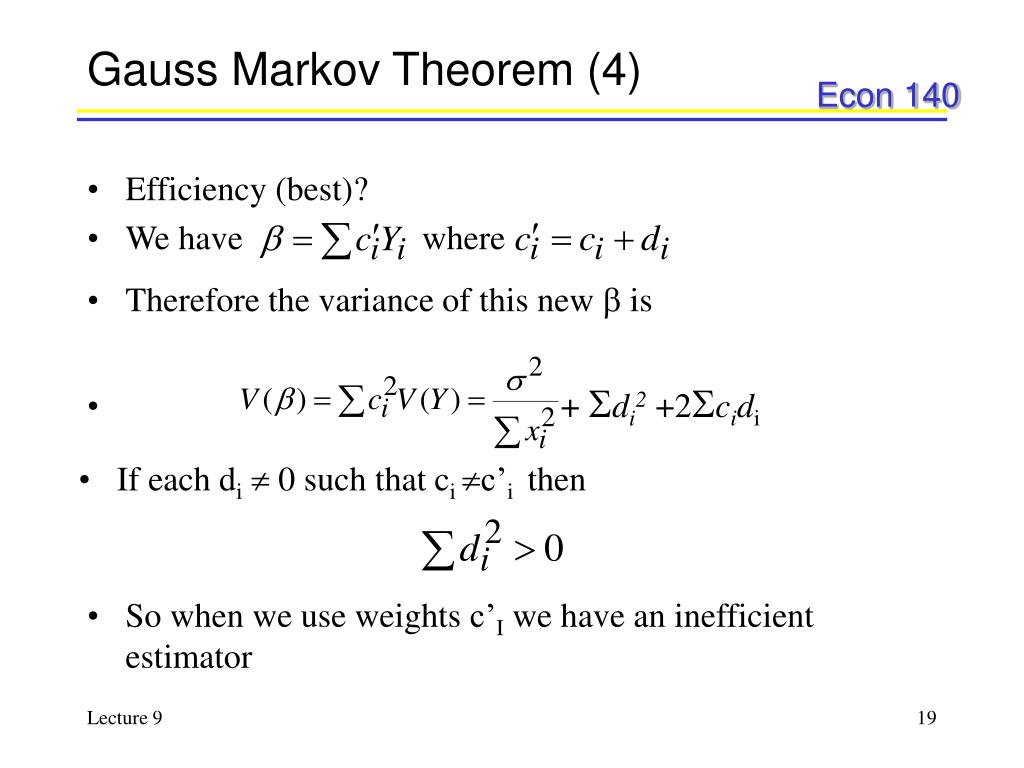

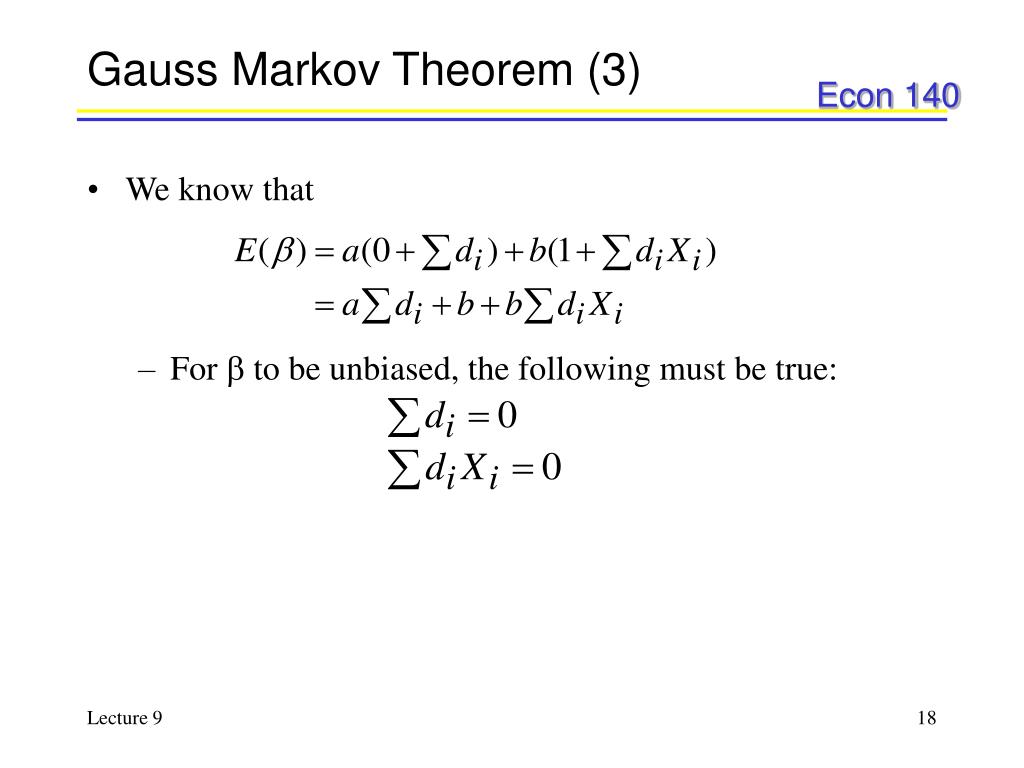

Weil sie uns das Gauss-Markov-Theorem schenken! Dieses Theorem ist wie ein Versprechen: Wenn alle Annahmen erfüllt sind, dann sind die Schätzer, die du mit der linearen Regression bekommst, die besten linearen, unverzerrten Schätzer (BLUE). Das bedeutet, dass sie im Durchschnitt richtig liegen (unverzerrt sind) und dass sie von allen linearen Schätzern die geringste Varianz haben (also am genauesten sind). Kurz gesagt: Du bekommst die bestmöglichen Ergebnisse!

Denke an Carl Friedrich Gauss und Andrey Markov als die Superhelden der Statistik! Ihre Arbeit hat die Grundlage für viele statistische Analysen gelegt.

Also, das nächste Mal, wenn du eine lineare Regression durchführst, vergiss nicht die Gauss-Markov-Annahmen. Sie sind der Schlüssel zu zuverlässigen und aussagekräftigen Ergebnissen. Und wer weiß, vielleicht entdeckst du ja selbst verborgene Beziehungen in deinen Daten!