The Mathematical Theory Of Communication

Hast du dich jemals gefragt, wie es möglich ist, dass dein WhatsApp-Chat so klar und deutlich bei deinem Kumpel ankommt, obwohl das Signal vielleicht tausende Kilometer durch die Luft gejagt ist? Oder warum manche Telefonate so krisselig klingen, als ob jemand eine Tüte Chips im Hintergrund knabbert? Keine Sorge, das hat nichts mit heimlichen Chipskonsum zu tun, sondern mit etwas super-spannendem: der Mathematischen Theorie der Kommunikation!

Was zum Kuckuck ist das?

Stell dir vor, du bist Flüstermeister bei einer supergeheimen Mission. Dein Ziel: Eine Botschaft von A nach B bringen, ohne dass sie total zerhackt ankommt. Genau darum geht's im Kern. Die Theorie, ursprünglich von Claude Shannon (dem absoluten Rockstar dieser Disziplin!) in den 1940ern entwickelt, ist wie ein super-detaillierter Bauplan, wie man Informationen perfekt verpackt, verschickt und wieder entpackt – selbst wenn unterwegs jede Menge Störungen lauern.

Der Bauplan für klare Botschaften

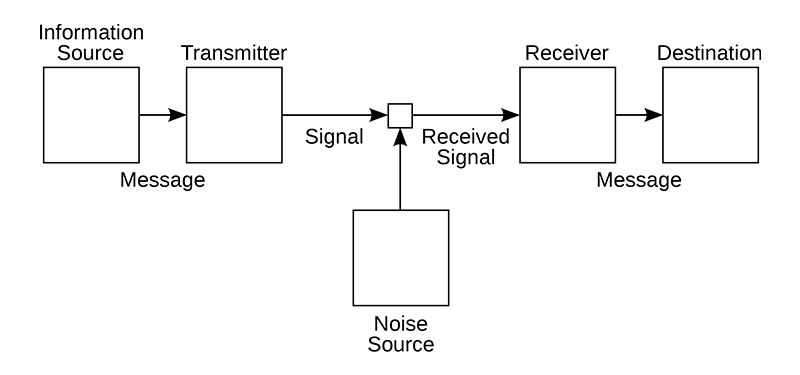

Im Grunde funktioniert es so: Zuerst hast du deine Nachricht, die in einen Code verwandelt wird. Denk an Morsecode, binäre Zahlen (0 und 1) oder einfach Buchstaben. Dann wird diese Nachricht über einen Kanal geschickt. Das kann ein Telefonkabel sein, eine Funkwelle oder sogar ein Brieftaubentransportunternehmen (ja, auch das!).

Hier kommt der Clou: Auf dem Weg lauern Störungen! Stell dir vor, der Wind pfeift deine Brieftaube vom Kurs ab, oder das Telefonkabel hat einen Wackelkontakt. Diese Störungen werden als Rauschen bezeichnet. Shannons geniale Idee war, Wege zu finden, wie man diese Störungen minimieren und die Nachricht trotzdem verständlich rüberbringen kann.

Entropie: Das Chaos im Griff behalten

Ein Schlüsselbegriff in Shannons Theorie ist die Entropie. Keine Panik, wir reden hier nicht über das Ende des Universums! Entropie ist einfach ein Maß für die Unsicherheit oder den Überraschungsgehalt einer Nachricht. Eine Nachricht mit geringer Entropie ist vorhersehbar und langweilig ("Hallo, wie geht's? Mir geht's gut."). Eine Nachricht mit hoher Entropie ist unerwartet und spannend ("Achtung! Einhorn auf der Tanzfläche!").

Je höher die Entropie, desto schwieriger ist es, die Nachricht fehlerfrei zu übertragen. Stell dir vor, du versuchst, ein super-kompliziertes Gedicht bei einem Orkan vorzutragen. Viel Glück dabei! Shannons Theorie hilft uns, die Entropie zu verstehen und Strategien zu entwickeln, um auch bei schwierigen Bedingungen klare Botschaften zu senden.

Redundanz: Doppelt hält besser!

Eine dieser Strategien ist die Redundanz. Das bedeutet, dass man zusätzliche Informationen in die Nachricht einbaut, um Fehler zu korrigieren. Denk an ein Passwort, das Groß- und Kleinbuchstaben, Zahlen und Sonderzeichen enthält. Diese zusätzlichen Elemente machen es schwieriger, das Passwort zu knacken, selbst wenn jemand ein paar Zeichen falsch errät.

Oder stell dir vor, du schickst eine SMS, in der du dreimal hintereinander "Ja" schreibst ("Ja, ja, ja!"). Selbst wenn eines der "Ja"s durch Rauschen verloren geht, ist die Botschaft immer noch klar. Redundanz ist wie ein Sicherheitsnetz für deine Botschaften!

Vom Telefon zum Streaming: Überall dabei!

Die Mathematische Theorie der Kommunikation ist viel mehr als nur eine trockene Theorie. Sie ist das Fundament für fast alles, was mit moderner Kommunikation zu tun hat. Ob du nun telefonierst, Musik streamst, eine E-Mail verschickst oder ein YouTube-Video anschaust – Shannons Prinzipien sind im Spiel.

Denk nur mal an das nächste Mal, wenn du ein Video in HD-Qualität ohne Ruckeln streamst. Das ist kein Zufall! Das ist das Ergebnis jahrelanger Forschung und Entwicklung, basierend auf Shannons genialen Ideen. Die Theorie hat es uns ermöglicht, Informationen schneller, zuverlässiger und effizienter als je zuvor zu übertragen. Und das ist doch wirklich etwas, worüber man sich freuen kann!

Also, das nächste Mal, wenn du ein Emoji verschickst, denk daran: Dahinter steckt eine ganze Menge Mathematik! Und dank Claude Shannon verstehen wir diese Mathematik ein bisschen besser.

.jpg)

![The Mathematical Theory Of Communication 📨 [𝙋𝙙𝙛] 𝘿𝙊𝙒𝙉𝙇𝙊𝘼𝘿 The Mathematical Theory of Communication by Claude E](https://img4.teletype.in/files/f9/25/f925f366-d2f6-4b99-b9fa-0d186f109060.png)